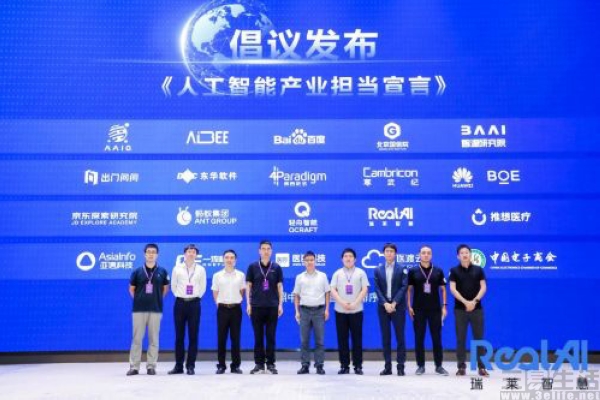

日前有消息显示,在首届全球数字经济大会人工智能产业治理论坛上,由北京智源人工智能研究院、瑞莱智慧联合发起,百度、华为、蚂蚁集团、寒武纪、爱笔科技、第四范式等企业和研究机构联合发布《人工智能产业担当宣言》(以下简称为“《宣言》”)。据悉,其旨在针对人工智能所带来的数据隐私、算法偏见、技术滥用等安全问题提出倡议,引导人工智能向善发展,并强调中国科技企业在推动人工智能发展中应积极承担的责任。

《宣言》中表示,“首先,人工智能系统的设计、研发、实施和推广,应符合可持续发展理念,以促进社会安全和福祉为目标,以尊重人类尊严和权益为前提。其次在技术能力方面,要最大限度确保人工智能系统安全可信,提高鲁棒性及抗干扰性,增强算法透明性和可解释性,同时保障各方权利和隐私,对用户数据给予充分的安全保障。”

其中还指出,在行业共治方面,人工智能产业层面需建立开放协作共享机制,倡导企业探索和构建开源开放协作共享机制和平台,构建企业间深度合作的伙伴关系,同时与政府、专家、媒体与公众等各方交流协作。

企业自治方面,人工智能从业者应具有高度的社会责任感和自律意识,并倡议企业成立人工智能治理委员会或工作组、设立伦理研究院岗位,或通过外部技术支持等多种方法履行责任。同时,促进企业与政府、社会深度协同治理,积极参与人工智能相关法律法规以及标准的制定和落实。

中国科学院院士、清华大学人工智能研究院名誉院长、瑞莱智慧首席科学家张钹在此次活动中提出,“人工智能与信息系统在安全性上拥有明显差别。信息系统安全性难题主要是软件开发中的系统漏洞,非常容易被处理。而第二代人工智能的安全性难题关键来源于深度神经网络优化算法自身的不安全,更为实质、更难摆脱。一方面要从法律法规、伦理规范、行业共识等不同层面去治标;另一方面要从技术创新层面发力去治本。”

【本文图片来自网络】